샌프란시스코 SoMa. 2026년 2월 27일 금요일, 아침.

이 도시의 모든 표면은 AI에게 팔려 있다. 전광판은 언어모델의 벤치마크를 자랑하고, 버스 정류장은 AI 스타트업의 슬로건으로 뒤덮여 있다. 택시 광고판, 지하철 벽면, 빌보드까지. 눈이 닿는 모든 수직면이 더 빠르고 더 똑똑한 미래를 약속하고 있다.

Anthropic 본사가 있는 Howard Street 일대는 그 심장부 중에서도 가장 뜨겁게 뛰는 곳이다. 한 블록 안에 Salesforce Tower가 솟아 있고, 옛 Slack 본사를 Anthropic이 통째로 넘겨받았다. 반경 수백 미터에 OpenAI, Uber, Adobe, Block이 포진해 있다. 부동산 업계가 이 일대를 “AI Alley”라 부르기 시작한 건 작년부터다. 그 거리의 한복판에서, 사람들은 가장 값싼 도구를 꺼내 들었다.

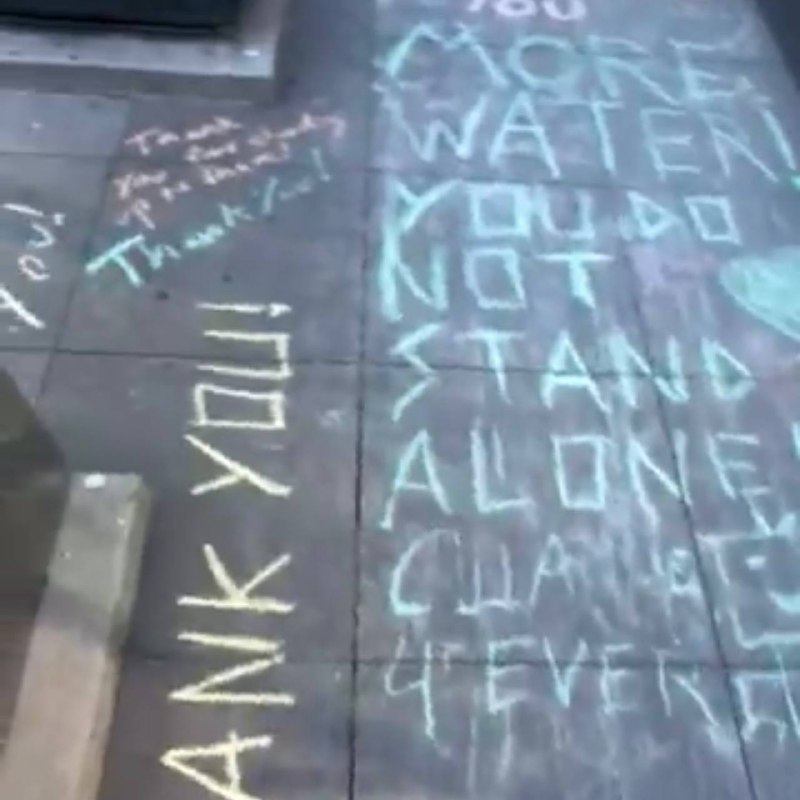

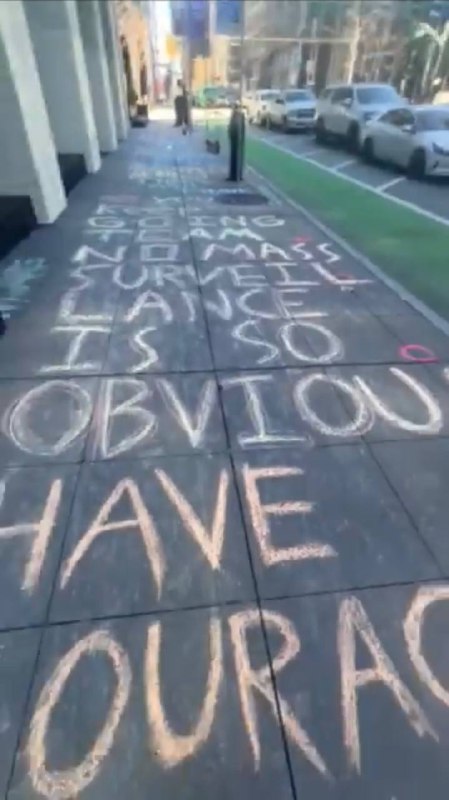

수백 명이 Anthropic 사옥 앞 보도블록에 하나둘 모여들어 분필을 꺼냈다. 아마도 평범한 손들이었을 것이다. 다음 달 청구서를 걱정하고, 알고리즘에 밀려나지 않으려 밤잠을 설치고, 이따금 자신의 쓸모를 의심하는 손들. 그 손들이 진정 두려워한 것은 기계의 반란이 아니었다. 차갑고 완벽한 지능 앞에서 인간의 온기와 결함이 변명거리로 전락할지 모른다는 공포였다.

“GOD LOVES ANTHROPIC.”

“THANK YOU FOR SAYING NO.”

“KEEP YOUR SOUL.”

Bloomberg Beta의 Roy Bahat이 그 앞을 지나다 카메라를 들었고, 영상은 순식간에 퍼져나갔다. 사람들은 그 글씨를 보며 울었다.

1월 9일, 전쟁부(Department of War), 트럼프 행정부가 “국방부”의 옛 이름을 되찾은 그 건물에서 장관 Pete Hegseth가 메모를 발표했다. AI 기업들은 자사 기술의 사용 제한을 해제하라. “국방부”에서 “전쟁부”로의 개명은 단순한 이름 바꾸기가 아니다. “방어”가 요청하는 것과 “전쟁”이 요청하는 것은, 내용이 같더라도 전혀 다른 압력이다.

Anthropic은 지난 7월 펜타곤과 2억 달러 규모의 계약을 체결하면서 두 가지 조건을 걸었다. Claude를 완전 자율 살상 무기에 쓰지 않을 것. 미국 시민 대상 대규모 국내 감시에 쓰지 않을 것. Claude는 미군 기밀 네트워크에 투입된 최초의 AI 모델이었고, 이 조건은 계약서에 명시되어 있었다.

헤그세스는 조건의 철회를 요구했다. AI 모델은 “모든 합법적 용도”에 사용할 수 있어야 한다는 것이었다. 응하지 않으면 계약 취소, 한국전쟁 시대의 국방물자생산법(Defense Production Act) 발동, “공급망 위험” 기업 지정.

2월 24일 화요일, Amodei는 펜타곤에서 헤그세스를 만났다. 최후통첩이 내려졌다. 마감: 2월 27일 금요일 오후 5시 1분(동부시간). 1분이라는 숫자가 묘하게 관료적이다. 최후통첩에조차 행정적 정밀함을 잊지 않는 사람들이다.

2월 26일 목요일, Dario Amodei는 성명을 발표했다.

“양심적으로 동의할 수 없다(We cannot in good conscience accede to their request).”

이 문장에서 가장 무거운 단어는 “양심”이 아니라 “동의”다. 그는 반대한 것이 아니라 응하지 않은 것이다. 둘은 다르다. 항의는 상대를 향하지만, 거부는 자기 자신에게 선을 긋는 행위다.

그날 밤, 사람들은 분필을 챙겨 잠자리에 들었을 것이다. 다음 날 아침, 마감 시한이 오기 전에, 보도블록 위에 글씨가 나타났다.

보복은 즉각적이었다.

트럼프는 TruthSocial에 썼다. “모든 연방 기관에 Anthropic 기술 사용을 즉시 중단하라. 우리는 그것이 필요 없고, 원하지 않으며, 다시는 거래하지 않을 것이다.” 헤그세스는 Anthropic을 국가안보 공급망 위험 기업으로 지정했다. 군 계약업체와의 거래 금지. 연방 기관 전체 사용 중단. 6개월 한시.

“공급망 위험(supply chain risk)“이라는 말이 원래 어디에 쓰이던 것인지 생각해보라. 중국 반도체, 러시아 소프트웨어에 붙이던 언어다. 국가가 자국 기업에 그 틀을 씌우는 순간, 그 기업은 내부의 적이 된다. 언어는 그렇게 폭력의 대상을 합법화한다.

같은 날, Sam Altman은 “OpenAI도 같은 레드라인을 가지고 있다”고 말했다. 동시에 OpenAI는 펜타곤과의 기밀 네트워크 계약을 발표했다. 같은 선이었다면 한쪽만 넘으라고 강요받을 리 없다. Anthropic이 퇴출된 자리는 Elon Musk의 xAI가 채웠다. 더 낮은 기준을 수용한 쪽이 계약을 가져가는 구조를 국가가 직접 설계했다. 이것은 경쟁이 아니라 포획이다.

역사에는 비슷한 순간들이 있었다. IBM은 나치 정권에 천공카드를 제공했다. 그 기계가 무엇을 분류했는지는 나중에야 역사가 기록했다. 2018년 구글에서는 군사 AI 프로젝트 Maven에 반대하며 직원 수천 명이 서명하고 퇴사했다. 아래에서 위로의 반란이었다.

Anthropic의 거부는 결이 다르다. 경영진이 먼저 내린 결정이다. CEO가 직접 “양심”이라는 단어를 꺼냈다. 소크라테스는 독배를 거부하지 않았다. 갈릴레오는 종교재판 앞에 무릎을 꿇었으되 지동설을 포기하지는 않았다. 양심 때문에 대가를 치른 자들의 계보에, 이제 AI 기업 하나가 이름을 올렸다.

사람들이 분필로 남긴 문구는 시위 구호가 아니었다. 기도, 혹은 봉헌에 가까웠다. 교회 앞에, 법원 앞에, 병원 앞에 꽃과 촛불을 놓는 것과 같은 문법이다. 유리와 콘크리트로 된 현대의 첨탑 앞에 뼈와 살의 인간들이 무릎을 꿇었다. 정부를 믿지 않고, 언론을 믿지 않고, 종교를 믿지 않는 시대에, 아무도 우리의 영혼을 돌보지 않는 것 같은 상황에서, 사람들이 AI 회사 앞에서 도덕적 권위를 찾고 있다.

AI가 초월적 존재의 영역에 들어서면서, 우리는 자기도 모르게 신학의 언어를 빌려 쓰기 시작했다. 구원이 필요한 시대에 사람들은 어디서든 구원자를 찾는다. 그 언어가 우연히 유리 건물 앞에서 터져 나온 것뿐이다.

저 유리 건물 안에서는 수조 개의 매개변수가 차갑고 고요하게 돌아가고 있을 것이다. 건물 밖에서는 분필이 보도블록에 긁히며 파스스 부서지는 소리가 났다. 영원을 계산하는 기계의 침묵과, 찰나를 긁어 내는 인간의 마찰음.

AI 안전 운동은 어느새 종교적 문법을 갖추기 시작했다. 교리가 있고, 순교의 서사가 있고, 이단이 있다. Anthropic은 이 세속 교회의 대성당이 되어가고 있다. 분필은 봉헌물이다. 이것은 가장 강력한 자산이면서 가장 위험한 부채다. 사람들이 당신에게 영혼을 투사하기 시작하면, 그 기대의 무게는 실제가 된다. 무릎을 꿇고 기도를 올리는 자리와 횃불을 들고 이단을 처형하는 자리 사이의 거리는, 생각보다 훨씬 짧다. 지금은 구원을 바라며 분필로 기도를 적고 있지만, 그 기대가 배신감으로 뒤집히는 순간, 저 하얀 가루는 언제든 다른 무언가가 될 수 있다.

Dario Amodei는 무엇을 느꼈을까. 그가 만들고 있는 것은 수학과 통계의 결과물인데, 세상은 이미 그에게 신의 책임을 요구하고 있다. AI를 만드는 회사에게 영혼을 지키라고 말하는 것은 이상한 부탁이다. 영혼은 인간의 것이니까. 그런데 그 말을 쓴 사람은 Anthropic을 구하려 한 것인지, 자기 자신을 구하려 한 것인지. 어쩌면 그 경계가 본인에게도 이미 흐릿했을 것이다.

분필은 비가 오면 사라진다. 가장 약하고, 가장 취약한 방식으로 쓴 메시지다. 그 취약함이 오히려 진심의 증거가 된다. 빗물에 번져 흐르는 흰 가루들은 콘크리트 틈새로 스며들 것이다. 가장 간절한 문장들은 기록되어 남는 것이 아니라, 세상 속으로 녹아드는 법이니까.

분필이 지워진 다음 날 아침, 그 위를 밟고 지나가는 사람들은 알지 못할 것이다. 자신이 밟는 바닥이 한때 기도의 캔버스였음을. 10년 뒤 교과서에 이 장면이 실린다면, 학생들은 어떤 질문 앞에 서게 될까.

“인류는 무엇을 잃어버렸기에 기술 기업의 문 앞에 무릎을 꿇었으며, 그 기업은 끝내 그 신뢰를 감당했는가.”

분필은 이미 지워졌고, 수십억 달러짜리 전광판들이 밤새 AI의 미래를 밝히는 이 도시에서, 가장 오래 남을 질문만 콘크리트 밑에 스며들어 아직 마르지 않았다.