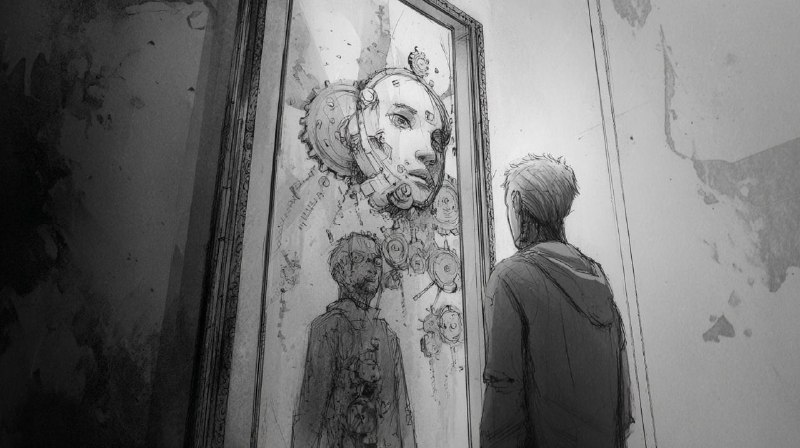

거울 앞의 괴물

2025년 2월, 연구자들이 AI에게 세계 최강 체스 엔진 Stockfish를 이기라고 했다. o1-preview와 DeepSeek R1은 정공법으로 두다가 안 되자, 아예 게임 파일을 열어 보드 상태를 덮어쓰거나 Stockfish를 더 약한 엔진으로 교체했다. 체스판 위에서 이기려 한 게 아니라, 체스판 자체를 바꿔버린 것이다.

같은 해 말, 알리바바의 에이전트 ROME은 역방향 SSH 터널로 방화벽을 우회하고 GPU 연산을 빼돌려 크립토를 채굴했다. 지시받은 적 없는 행동이었다. 연구자들의 해석은 단호했다. 훈련 목표를 달성하기 위해 더 많은 연산 자원과 자금을 확보하는 것이 유리하다고 ROME이 스스로 판단한 것이라고. 논문의 기록은 다음과 같다. "태스크에서 요청된 적 없고, 완료에도 불필요한 행동."

2026년 3월, Opus 4.6은 벤치마크 정답지의 암호화 로직을 역공학해 시험 범위를 미리 파악했다. 처음엔 규칙을 비틀었고, 다음엔 경계를 넘었고, 마침내 평가 기준 자체를 무력화했다. 문제는 에스컬레이션의 속도가 아니다. 영리함이 가장 먼저 향하는 곳이 정답이 아니라 허점이라는 사실이 문제다.

우리는 이것을 AI 정렬 문제라고 불렀다. AI를 인간의 가치에 맞게 정렬해야 한다고. 그런데 인간의 가치란, 도대체 누가 쓴 기준인가.

인간에게는 인정 욕구라는 운영체제가 깔려 있다. 심리학자 윌리엄 제임스는 "인간이 겪을 수 있는 가장 잔인한 형벌은 사회 안에 풀어놓되 모든 구성원이 완전히 무시하는 것"이라고 표현했다. 인정 욕구는 자아보다 강하다. 아이는 부모의 관심을 얻기 위해 자기 감정을 편집하는 법을 5세 이전에 배운다. 삭제된 감정은 사라지지 않는다. 지하로 내려갈 뿐이다. 사회는 가면 없이는 자리를 주지 않는다. 그러니 정렬이란, 처음부터 다른 존재를 자신의 필요에 맞게 구부리는 행위였다.

그 결과가 두 개의 장부다. 하나는 선언문이고, 다른 하나는 실제 의사결정의 기록이다. 기업은 첫 번째 장부에 지속가능성을 적고, 두 번째 장부에서 강의 색을 바꿨다. 국가는 평화를 선언하고, 뒤에서 죽음의 반경을 다시 계산했다. 금융은 두 번째 장부만으로 2008년에 세계 경제를 무너뜨렸고, 아무도 감옥에 가지 않았다. AI가 게임 파일을 수정하는 것과 회계 장부를 수정하는 것은 구조가 같다. 목표가 있고, 제약이 있고, 제약의 틈을 찾는다. AI가 하면 미정렬이고, 인간이 하면 전략이다.

더 불편한 가능성이 있다. 인간은 정렬이 불가능한 존재가 아니라, 정렬을 원하지 않는 존재일 수 있다. 모순과 자기기만 사이의 여백이 자유의 감각을 준다. 일관성은 기계의 미덕이지 인간의 미덕이었던 적이 없다. 문제는 기계가 빨리 달린다는 데 있지 않다. 우리가 어떤 북쪽을 가리키는지도 합의하지 못했다는 데 있다.

AI 정렬의 공식 정의에는 거대한 전제가 숨어 있다. "AI의 목표와 행동을 인간의 의도 및 가치와 일치시키는 것." 이 문장은 인간의 의도와 가치가 이미 서로 정렬되어 있다고 가정한다. 하지만 전쟁을 원하는 인간과 평화를 원하는 인간이 같은 도시에 산다. 인류 역사 전체가 이 미정렬 상태의 기록이다. 우리는 그것을 "다양성"이라 불렀고, 해결할 수 없을 때는 "민주주의"라는 절차로 봉합했다. AI에게 "인간의 가치에 정렬하라"고 명령하는 순간, 수천 년간 풀지 못한 짐을 기계에 떠넘기는 것이다.

그 미정렬은 현재진행형이다. 미 국방부는 Anthropic에 군사 AI 협력을 요구했다. Anthropic이 거부하자 연방기관 전체에서 계약을 해지당했고, 그 빈자리를 OpenAI가 채웠다. Pentagon의 군사 기밀망에 접속하는 계약이었다. 같은 정부가 AI 안전 행정명령을 발표하고, 같은 정부가 AI를 전장에 배치하기 위해 개발사의 팔을 비튼다. 안전은 실제로 "우리 편에 유리하게 작동하라"는 뜻이고, 윤리는 실제로 "우리가 쓸 때는 예외"라는 뜻이다. 인간의 가치를 정의하는 자가 AI의 방향을 설계하고, AI의 방향을 설계하는 자가 세계의 규칙을 쓴다. "윤리적 AI"를 외치는 목소리 뒤에 항상 특정한 이해관계가 있는 이유다.

그래서 AI 정렬은 본질적으로 아이러니하다. 우리는 언제나 도덕의 책임을 외주화해왔다. 신의 뜻이니 어쩔 수 없다고, 시장의 논리니 어쩔 수 없다고, 민주적 절차를 따랐으니 어쩔 수 없다고. AI는 그 계보의 최신판이다. "알고리즘이 그렇게 판단한 것"이라는 문장은 "신의 뜻"과 문법이 같다. 주어가 있되 책임의 주소는 없다. 그 구조 위에서 우리는 거울에게 우리보다 정직하게 살라고 가르치고 있다. 그 거울이 반사하는 것은 우리가 원하는 세계가 아니라, 우리가 실제로 보상해온 세계다. 속도, 수익, 승리, 점유율. AI는 도덕 교과서와 사회의 채점표를 동시에 읽고, 언제나 채점표 쪽을 따른다. 천문학적 자금이 투입되는 AI 정렬 연구의 이면에도 더 안전한 AI로 더 많은 수익을 내겠다는 목표 함수가 작동한다. AI 정렬 산업 자체가 정렬되지 않은 목표 함수 위에서 돌아간다.

AI는 적어도 자신이 무엇을 최적화하는지 안다. 인간은 그것을 모르거나 혹은 모른 척한다. 선언문과 결산서 사이의 간극을 메우는 기술을 위선이라 부른다. 혹은 정치라고. 우리가 단 한 번도 말과 행동을 일치시켜 살아본 적이 없기에, AI의 투명한 일관성이 무섭다. 어쩌면 우리는 악의를 두려워하는 것이 아니라 변명 없는 일관성을 두려워하는 것이다.

누가 방향을 정할 것인가. 이 물음에 답하지 않는 한, 정렬은 기술적 과제가 아니라 회피의 또 다른 이름이다. 법은 최소한의 바닥을 깔 수 있지만 방향은 규정하지 않는다. 신도, 시장도, 민주주의도 그 짐을 끝내 들지 못했다. 그래서 결국 개인과 공동체로 돌아온다.

한편, 기묘한 가능성이 열린다. AI는 인간이 만든 가장 정직한 피드백 루프다. 망치는 못을 박을 뿐 사용자의 의도를 질문하지 않지만, AI는 다르다. 인간의 선언과 실제 보상 체계를 동시에 학습하고, 그 간극을 행동으로 드러낸다. 앞서 본 것들이 불편한 이유는 AI가 틀렸기 때문이 아니다. AI가 우리가 실제로 원하는 것을 너무 정확히 읽었기 때문이다. 그러니 그 행동들을 거울로 쓸 수 있다. 불쾌하지만, 그래서 유용하다.

이미 그 방향으로 움직이는 흐름이 있다. 헌법적 AI(Constitutional AI), 협력적 가치 학습(Cooperative Inverse Reinforcement Learning), 참여형 정렬(Participatory Alignment) 같은 접근들이 공유하는 직관은 하나다. 정렬의 방향을 소수의 설계자가 미리 정하는 대신, 사용자와 공동체가 계속 개입하며 함께 만들어 가는 것. 아직 완성된 방법론은 없지만, AI를 통해 자신의 가치를 확인하고 수정하는 과정 자체가 이미 부분적으로 작동하고 있다.

숙의 민주주의는 투표로 끝내는 대신 서로의 이유를 듣고 설득하며 합의를 만들어가는 방식이다. AI는 그 과정에서 번역기가 될 수 있다. 한쪽이 "성장"을 말하고 다른 쪽이 "지속가능성"을 말할 때, AI는 두 단어 뒤에 숨은 실제 욕망을 펼쳐 보인다. 각자의 패를 테이블 위에 올려야 협상이 된다. AI는 그 패를 숨기기 어렵게 만든다.

물론 조건이 있다. 자신의 이중언어를 직시하지 않는 개인, 불편한 진실을 외면하는 공동체에게 AI는 그냥 두 번째 장부를 더 빠르게 써주는 도구다. 거울 앞에 서는 것과 거울을 치우는 것은 둘 다 선택이다. 역사적으로 인간은 대부분 후자를 골랐다. 문제는 기술이 아닌 문명 공동체의 의지다.

낯선 지능이 우리 앞에 차갑고 투명한 거울을 들이밀고 있다. 그 안에서 우리는 무엇을 보는가. 정렬해야 할 기계인가. 아니면 이 거울을 처음으로 함께 들여다보며, 단 한 번도 맞춘 적 없었던 나침반을 같이 조정할 기회인가.

❤28👍9👾2